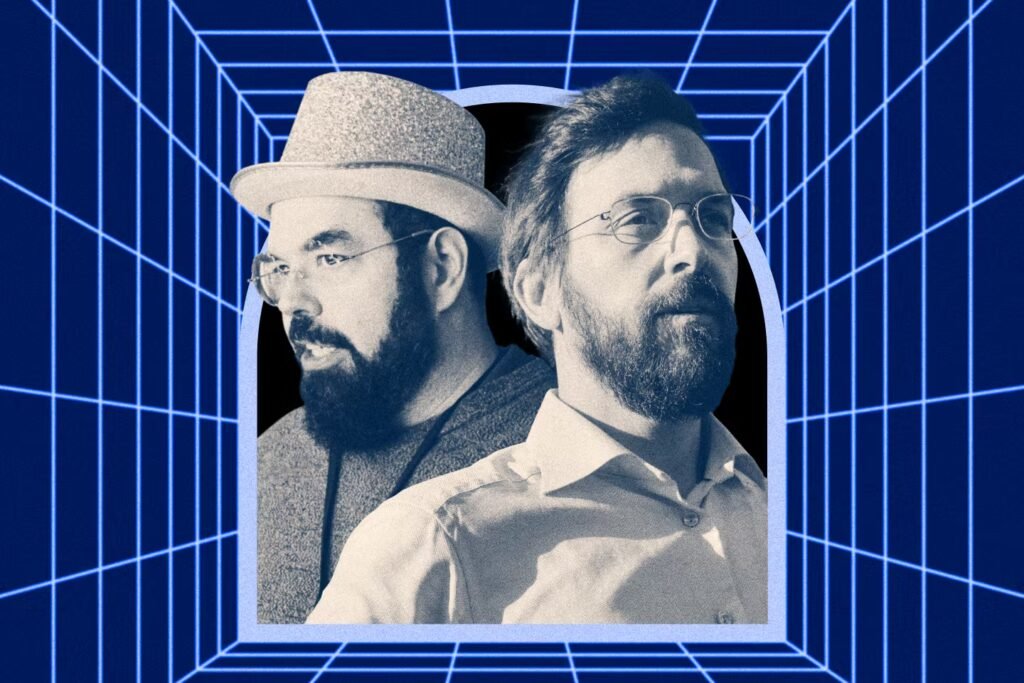

Eliezer Yudkowsky es uno de los primeros catastrofistas, uno de esos “jinetes del Apocalipsis” que advirtió sobre los peligros existenciales de la inteligencia artificial (IA) incluso antes de que existiera. Fue en 2000, hace un cuarto de siglo, cuando tenía poco más de veinte años, que este nativo de Chicago, educado en la ortodoxia judía pero convertido en ateo, creó el Machine Intelligence Research Institute (MIRI) en Atlanta y luego en Berkeley, California, para trabajar en inteligencia artificial.

Dotado de un extraordinario cociente intelectual, el joven, que abandonó los estudios por motivos de salud, decidió saltarse los estudios universitarios. Le apasiona el momento en que la máquina supere al cerebro humano. Pero, muy rápidamente, cree identificar un problema: la falta de alineación de los valores de la IA con los de los humanos. Y decide centrar su investigación en el tema de la “inteligencia artificial amigable”.

Entre las ideas exploradas, Eliezer Yudkowsky divulga, con el filósofo de Oxford Nick Bostrom, autor, en 2014, de Superinteligencia (publicado por Dunod en 2017), conceptos como “ortogonalidad” (la idea de que la inteligencia y la benevolencia son rasgos distintos y que un sistema de IA no se volvería automáticamente más amigable a medida que se vuelve más inteligente) y “convergencia instrumental”, la idea de que un sistema de IA poderoso y orientado a objetivos podría adoptar estrategias que, en última instancia, perjudican a los humanos.

Te queda el 72,45% de este artículo por leer. El resto está reservado para suscriptores.