Google ha ampliado las capacidades de verificación de su asistente de inteligencia artificial, Gemini, que ahora puede analizar un vídeo para entender si fue creado con un software de inteligencia artificial desarrollado por la propia Gran G. De hecho, sólo puede encontrar la marca de agua invisible insertada automáticamente por la IA de la empresa, que distingue el contenido real del contenido artificial.

“Géminis utilizará su propio razonamiento para dar una respuesta precisa en la línea de tiempo involucrada”, se lee en el blog. Se trata de la misma técnica que la compañía lanzó en noviembre para verificar fotografías utilizando Gemini, ahora aplicada a vídeos.

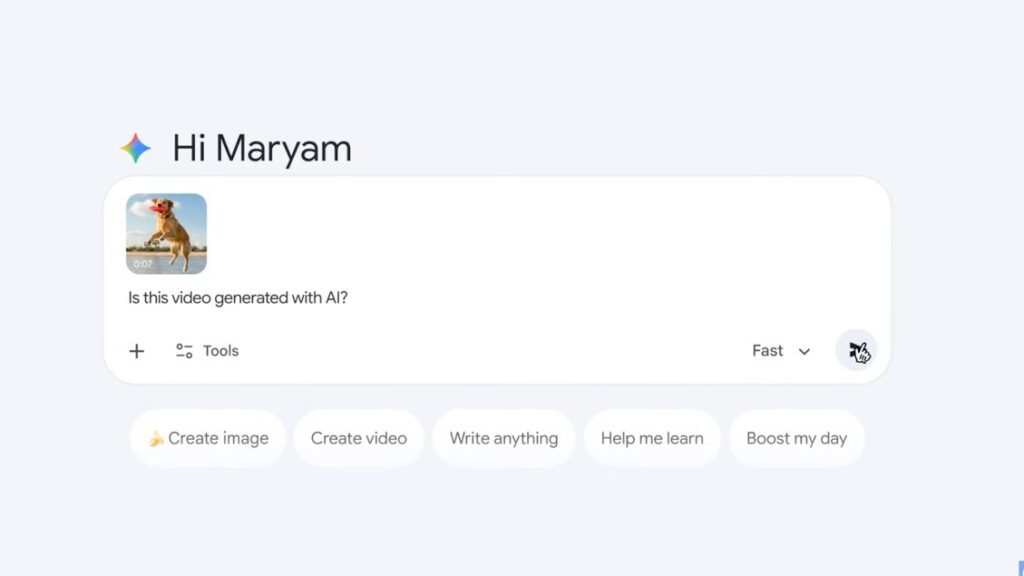

Para realizar la verificación, un usuario debe cargar un archivo de hasta 100 megabytes de tamaño y hasta 90 segundos de duración en el cuadro de diálogo Gemini. Básicamente, un clip breve, como los que circulan en las redes sociales. Gemini puede proporcionar retroalimentación detallada, indicando segmentos temporales específicos en los que se identifica la presencia de contenido sintético y utilizando tecnología capaz de buscar elementos digitales imperceptibles para el ojo humano.

Según el sitio especializado The Verge, la ausencia de un sistema de etiquetado común para las principales plataformas de IA plantea un problema. “La ausencia general de un sistema coordinado permite que los deepfakes pasen desapercibidos, especialmente en las redes sociales”, escribe el periódico.

Reproducción reservada © Copyright ANSA