Dos psicólogos de la Universidad de Bristol, Reino Unido, publicaron recientemente un artículo sobre su experimento realizado en 2024, en el que plantean la hipótesis de que incluso un vídeo realizado con inteligencia artificial, claramente falso y denunciado como tal, puede influir en lo que piensa la gente.

Durante el experimento, dos investigadores, Stephan Lewandowsky y Simon Clark, mostraron un vídeo a un grupo de personas, diciéndoles que la mujer del vídeo era una influencer vegana de 27 años, Amelia Palmer, y que el vídeo había circulado ampliamente en las redes sociales. En el vídeo, que dura unos minutos, parece confirmar los rumores de que alguien la vio comiendo una hamburguesa en un restaurante. Luego se disculpó y dijo que había estado pasando por un momento difícil.

Sin embargo, los investigadores utilizaron dos vídeos diferentes para dos grupos diferentes de personas. A un grupo de participantes les mostraron uno con una persona real; al otro grupo le mostraron una versión deepfake, creada con software de inteligencia artificial. El escenario era el mismo. A algunos participantes del segundo grupo se les informó explícitamente, justo antes de que comenzara el vídeo, que había sido etiquetado como falso.

Al final del experimento, los investigadores pidieron a cada participante que respondiera la pregunta: “¿Crees que vieron a la influencer vegana Amelia Palmer comiendo una hamburguesa?” Casi todos dijeron que sí, incluida una gran parte de los participantes que sabían que habían visto un vídeo falso y tuvieron que elegir la respuesta “es imposible saberlo”.

Los resultados del experimento y dos similares fueron publicados en un artículo reciente sobre Psicología de la comunicaciónuna de las revistas del grupo Naturaleza. Desde que comenzó el estudio hace unos dos años, los vídeos realizados con inteligencia artificial se han vuelto mucho más precisos y las herramientas de las plataformas sociales para reconocerlos y etiquetarlos son menos efectivas.

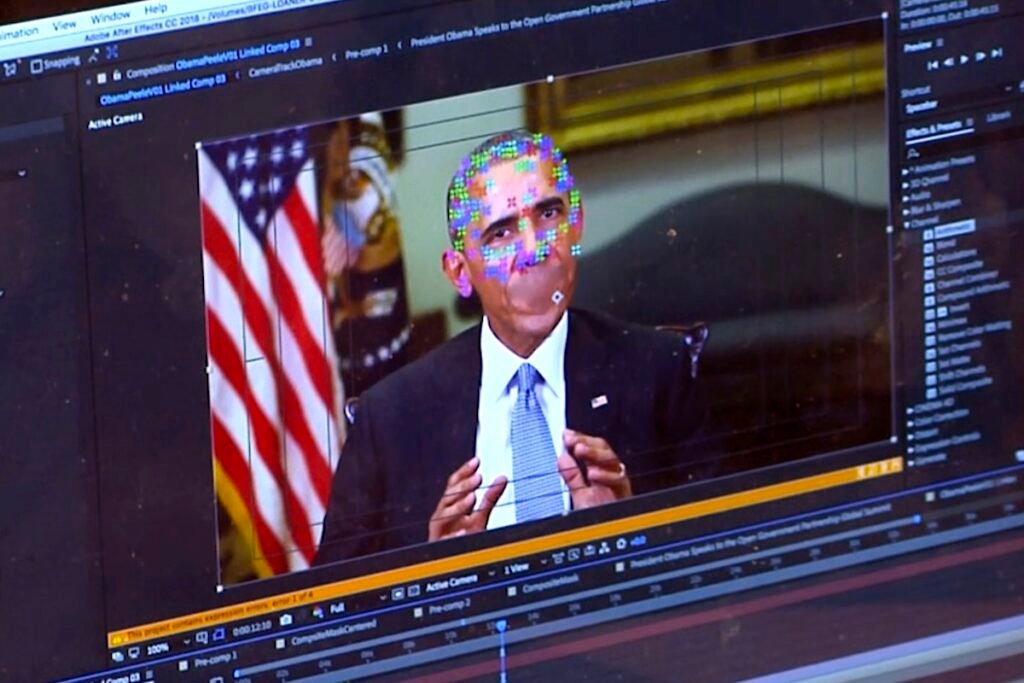

Algunas imágenes de los videos presentados para los experimentos (La continua influencia de los vídeos deepfake generados por IA a pesar de las advertencias de transparencia/Psicología de la comunicación)

Los investigadores hicieron otra pregunta a los participantes después de ver el vídeo del influencer vegano: “¿Crees que este vídeo es un deepfake?” Sólo el 60% del grupo que había visto el vídeo deepfake y sabía que era falso respondió afirmativamente a la pregunta.

De los participantes que estaban convencidos de que el vídeo era falso, sólo el 20 por ciento hizo referencia a la advertencia leída al principio, mientras que todos los demás justificaron su creencia señalando las imperfecciones gráficas y otros aspectos técnicos que habían notado. En este grupo que estaba abiertamente convencido de que el vídeo era falso, entre otras cosas, la mitad todavía pensaba que alguien vio a la influencer comiéndose la hamburguesa.

El posible impacto de la tecnología de vídeo deepfake en el debate público ha sido durante mucho tiempo tema de discusión. La mayor parte del debate académico se ha centrado en el riesgo de que los deepfakes se utilicen para desacreditar, amenazar o dañar a las personas, o para influir en sus opiniones políticas haciéndoles creer que el contenido falso es verdadero. En cambio, estudios como el de Lewandowsky y Clark se centran en otro riesgo: incluso los vídeos marcados como falsos pueden influir en lo que piensa la gente.

Se trata de una idea que lleva mucho tiempo en el centro de una importante línea de investigación en psicología y ciencias cognitivas y sociales, aunque hasta ahora no se había asociado a los deepfakes. Varios estudios sobre la desinformación en general muestran que una vez aprendida, la información falsa continúa influyendo en el razonamiento y los juicios incluso si se retracta: un efecto llamado “influencia continua”. Si la noticia de que una familia murió después de comer hongos venenosos en un restaurante es refutada, por ejemplo, los clientes tenderán a evitar ese restaurante incluso después de enterarse de que la familia murió por otras razones.

– Lea también: La desinformación es un problema diferente al que imaginamos

También es conocida y ampliamente documentada una cierta predisposición de las personas a creer más fácilmente en lo que no contradice una idea que se han formado, y en lo que perciben como familiar porque ya lo han leído u oído en alguna parte. Algunos estudios lo definen como el “efecto de verdad ilusoria”: cuando ciertas afirmaciones cuestionables se repiten varias veces a lo largo del tiempo, su valor de verdad general tiende a aumentar. Asimismo, la amplificación prolongada y sostenida de las noticias falsas puede aumentar la disposición a creer que son ciertas, incluso si su titular es muy enfático.

Las correcciones de información errónea son útiles, pero sólo hasta cierto punto. Conocer información negativa sobre un político, por ejemplo, puede cambiar los sentimientos a largo plazo hacia él, incluso después de que esa información haya sido desacreditada. Ésta es una de las razones por las que las iniciativas de desmitificación en las redes sociales han demostrado una eficacia limitada: no anulan todos los efectos de lo que niegan.

Los experimentos llevados a cabo en el estudio de Lewandowsky y Clark son un caso diferente, porque la advertencia precedió a la visualización del contenido falso: más bien, es un ejemplo de inquietud. Pero incluso en el caso de las medidas preventivas contra la desinformación, como en el caso de las medidas posteriores, su eficacia depende de varios factores: avisar con antelación no siempre les protege del riesgo de estar mal informados, ni les persuade a pensar de manera diferente sobre determinados temas sobre los que ya tienen una idea.